后端开发与Python人工智能基础软件开发的融合实践

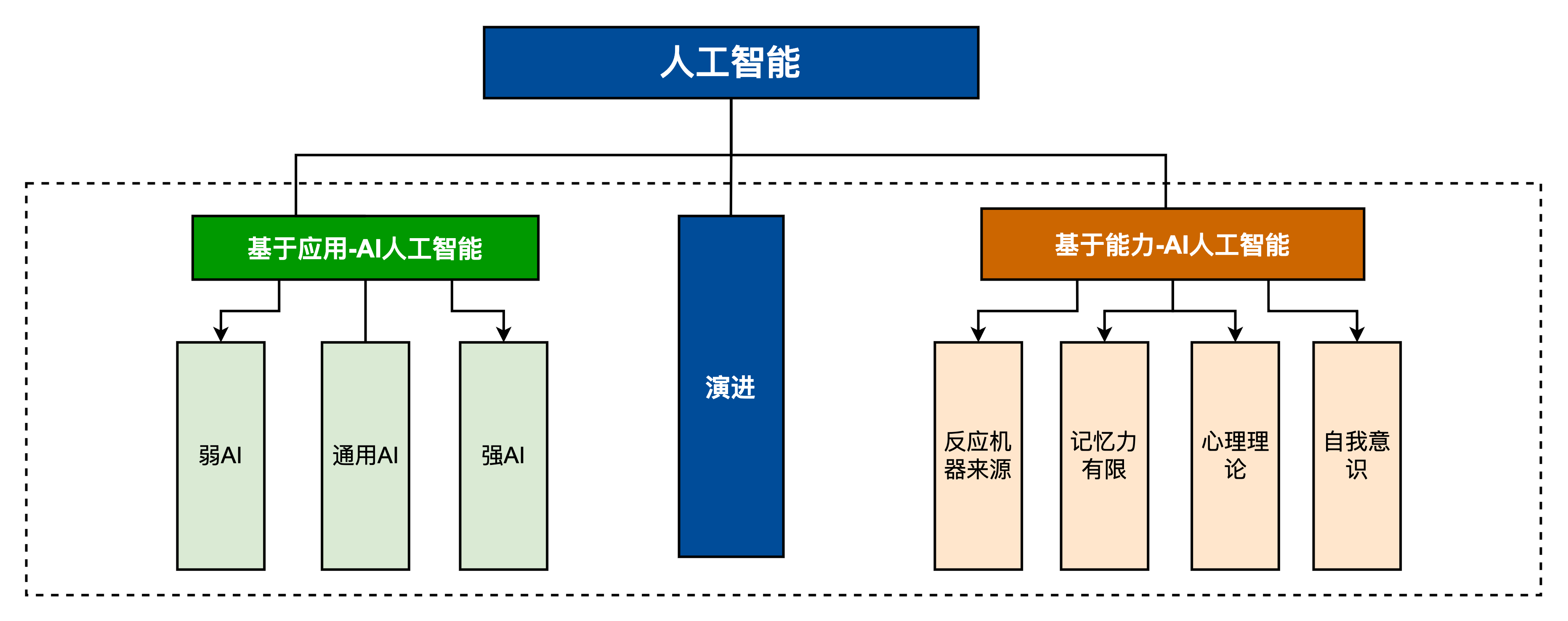

在当今数字化时代,后端开发作为软件系统的核心支撑,正与人工智能(AI)技术深度融合,推动着智能化应用的广泛落地。Python,凭借其简洁的语法、强大的生态系统以及在数据科学和机器学习领域的统治地位,已成为连接后端服务与AI模型开发的首选语言。本文将探讨如何利用Python进行人工智能基础软件开发,并集成到稳健的后端架构中。

一、 Python在后端与AI开发中的核心优势

Python之所以能成为后端与AI交叉领域的宠儿,主要得益于以下几个关键特性:

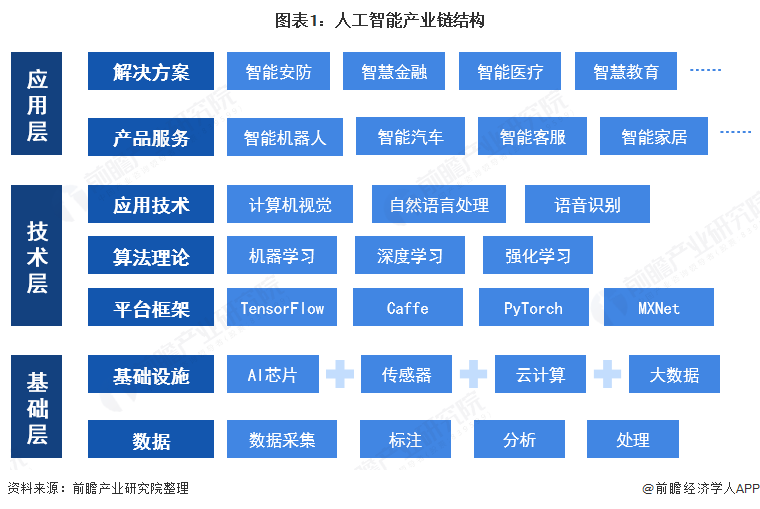

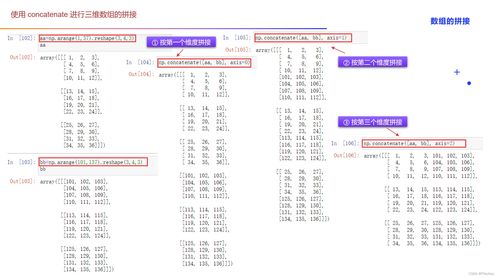

- 丰富的库与框架:对于后端,有Django、Flask、FastAPI等成熟的Web框架,能快速构建RESTful API或微服务。对于AI,则有NumPy、Pandas进行数据处理,Scikit-learn用于传统机器学习,TensorFlow、PyTorch构建深度学习模型。

- 开发效率与可读性:Python语法清晰,降低了开发复杂AI逻辑和后端业务逻辑的门槛,有利于团队协作和快速迭代。

- 强大的社区与生态:无论是解决后端并发问题,还是调试一个复杂的神经网络,都能找到丰富的开源解决方案和社区支持。

- 无缝集成能力:Python可以轻松调用C/C++库以提升性能,也能通过gRPC、消息队列(如RabbitMQ、Kafka)或REST API与其他语言的后端服务通信。

二、 人工智能基础软件的后端架构考量

将AI能力融入后端系统,并非简单地将模型脚本放入服务器。它需要一套深思熟虑的架构设计:

- 模型服务化(Model Serving):这是核心环节。训练好的AI模型需要以服务的形式提供预测功能。常用方案包括:

- 专用服务框架:使用TensorFlow Serving、TorchServe 或 MLflow Models 将模型封装成高性能的推理服务。

- API封装:利用FastAPI 或 Flask 快速构建轻量级预测端点,内部加载模型进行推理。FastAPI因其异步支持和自动API文档生成而备受青睐。

- 容器化部署:使用Docker将模型、依赖和环境打包成镜像,通过Kubernetes进行编排管理,实现弹性伸缩和高效运维。

- 数据处理与特征工程管道:后端接收的原始数据(如用户请求、日志数据)往往需要经过与训练时一致的处理流程(如清洗、标准化、特征提取)才能输入模型。这一管道需要作为后端服务的一部分被可靠地执行。

- 异步任务与队列:AI模型推理,尤其是深度学习模型,可能是计算密集型或耗时的。为避免阻塞主请求线程,应将推理任务放入任务队列(如Celery + Redis/RabbitMQ),由后台工作进程异步处理,并通过轮询或WebSocket通知客户端结果。

- 监控与可观测性:AI模型存在“模型衰减”问题。后端系统需要集成监控,不仅追踪API的延迟和错误率,还需监控模型的输入数据分布(防止数据漂移)和预测性能(如准确率、AUC等业务指标)。工具如Prometheus、Grafana和专门的MLOps平台(如Weights & Biases, MLflow)在此至关重要。

三、 实践流程:从开发到部署

一个典型的Python AI后端项目开发流程可能包含以下步骤:

- 原型与模型开发:数据科学家或算法工程师使用Jupyter Notebook或Python脚本,利用PyTorch/TensorFlow进行模型探索、训练与验证。

- 模型导出:将训练好的模型序列化为标准格式(如PyTorch的

.pt, TensorFlow的SavedModel,或通用的ONNX格式),便于跨平台服务化。 - 后端服务开发:

- 使用FastAPI构建主应用,定义接收数据的Pydantic模型和预测端点。

- 在服务启动时加载序列化的AI模型。

- 实现预处理和后处理逻辑,将业务数据转化为模型输入,并将模型输出转化为业务响应。

- 集成数据库(如PostgreSQL)、缓存(Redis)和身份认证等传统后端组件。

- 异步推理集成:对于重负载任务,设计Celery任务,将推理请求放入消息队列。FastAPI端点负责接收请求、创建任务并返回任务ID,另一个端点供客户端查询任务结果。

- 容器化与部署:

- 编写Dockerfile,基于精简的Python镜像(如

python:3.11-slim),复制代码、安装依赖、加载模型文件。

- 使用docker-compose或Kubernetes编排多个服务(Web应用、Redis、Worker进程、数据库)。

- 在CI/CD流水线中集成自动化测试(包括单元测试、模型推理测试)和镜像构建。

四、 挑战与最佳实践

- 性能:Python在CPU密集型推理上可能有瓶颈。解决方案包括:使用模型量化、剪枝优化模型;利用CUDA进行GPU加速;或用Cython重写关键部分;对于超高并发场景,考虑使用更快的运行时(如JAX)或将核心推理用C++实现,再由Python调用。

- 版本管理与回滚:模型和数据预处理代码的版本必须严格管理。MLflow等工具可以追踪模型版本、参数和指标。部署时应具备快速回滚到之前稳定模型版本的能力。

- 安全:AI后端面临新型威胁,如对抗性攻击、模型窃取。需实施输入验证、速率限制、API密钥认证,并对敏感训练数据进行脱敏处理。

- 成本控制:GPU实例成本高昂。需根据负载动态伸缩(Kubernetes HPA),或采用服务器less推理服务(如AWS SageMaker、Google AI Platform)。

###

以Python为桥梁,后端开发与人工智能基础软件开发的界限正变得越来越模糊。成功的AI驱动型应用,不仅需要一个精准的模型,更需要一个健壮、可扩展、可维护的后端系统来承载它。通过采用微服务架构、容器化技术、异步任务处理和全面的MLOps实践,开发者能够构建出既智能又可靠的生产级系统。随着边缘计算和实时AI需求的增长,这种融合的趋势将更加深入,对开发者的全栈能力——涵盖数据、算法、软件工程和基础设施——提出更高的要求。

如若转载,请注明出处:http://www.wmvpau.com/product/56.html

更新时间:2026-05-29 22:36:11