维护您的安全 人工智能基础软件开发的新征程

在数字化浪潮席卷全球的今天,人工智能(AI)已从科幻概念演变为推动社会进步的核心引擎。随着AI技术的广泛应用,其背后的安全与可靠性问题日益凸显。作为技术发展的基石,人工智能基础软件开发的每一步都至关重要,它不仅关乎技术创新的高度,更直接关系到用户隐私、数据安全乃至社会信任。本文将探讨AI基础软件开发的关键环节,以及如何在这一过程中筑牢安全防线,让技术真正服务于人类福祉。

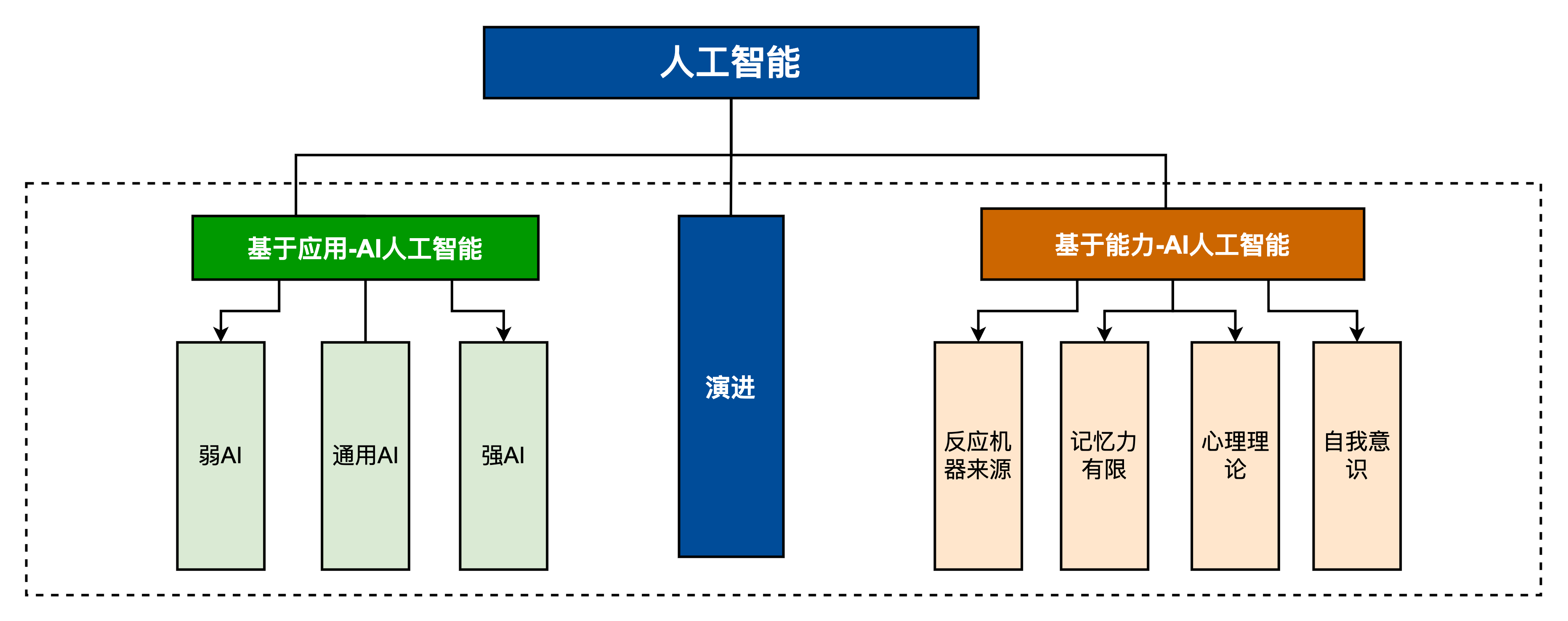

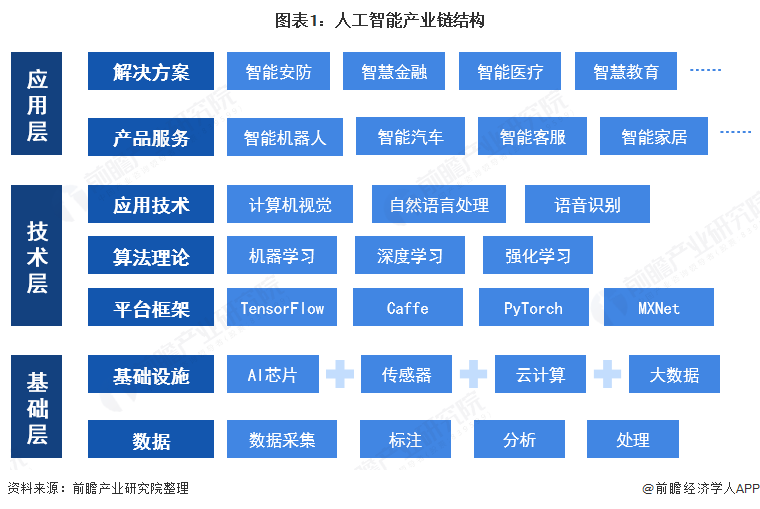

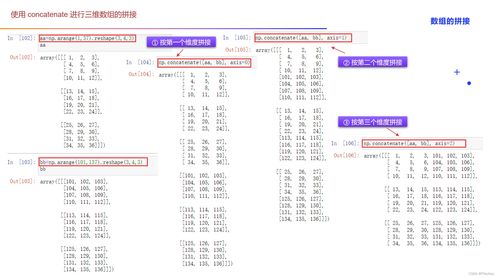

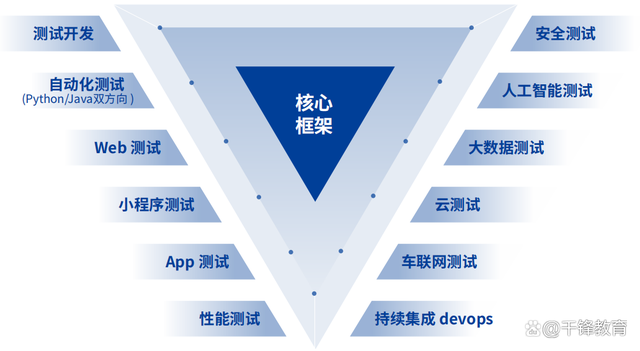

人工智能基础软件是指支撑AI系统运行的核心框架、库、工具及平台,如TensorFlow、PyTorch等深度学习框架。这些软件构成了AI应用的“操作系统”,决定了算法的效率、可扩展性及安全性。在开发初期,安全理念就必须融入设计之中。这意味着开发者需要从架构层面考虑潜在风险,例如数据泄露、模型被恶意篡改或算法偏见等。通过采用安全编码实践、定期进行代码审计和漏洞扫描,可以有效降低软件自身的脆弱性。

数据是AI的“燃料”,而数据安全则是基础软件开发中的重中之重。在训练模型时,如何确保用户隐私不被侵犯?差分隐私、联邦学习等新兴技术为此提供了解决方案。差分隐私通过在数据中添加噪声,使得单个用户的信息无法被识别,同时保持整体数据的统计有效性;联邦学习则允许数据在本地设备上进行处理,仅共享模型更新而非原始数据,从而大幅降低泄露风险。这些技术的集成,要求开发者在软件设计时具备前瞻性思维,将隐私保护作为默认功能而非事后补丁。

模型的可解释性与公平性也是安全维护的重要维度。一个“黑箱”式的AI系统可能隐藏着不可预见的偏见,导致歧视性决策,尤其在医疗、金融等关键领域。基础软件开发需纳入可解释AI(XAI)工具,帮助用户理解模型决策的逻辑,并检测潜在的偏差。通过开源社区的合作与透明度倡议,开发者可以共同建立伦理准则,确保软件不仅高效,而且公正。

在部署与运维阶段,持续的安全监控不可或缺。AI系统并非一劳永逸,它们需要应对不断变化的威胁环境。基础软件应支持动态更新机制,及时修补漏洞,并提供日志记录与异常检测功能。例如,对抗性攻击可能通过细微输入扰动欺骗模型,开发者需在软件中集成防御模块,增强系统的鲁棒性。建立用户反馈渠道,让安全成为一场持续的对话,而非单向的输出。

跨领域的合作是推动AI安全发展的关键。政府、企业、学术界及公众需共同参与标准制定与法规完善。基础软件开发作为技术生态的枢纽,应积极拥抱开源精神,促进知识共享与创新。只有通过全球协作,我们才能构建一个既智能又可信的AI让“维护您的安全”从口号变为现实。

人工智能基础软件开发是一场融合技术创新与伦理责任的旅程。它将代码转化为守护之力,在每一个算法背后,是对人性尊严的承诺。随着技术的不断演进,我们期待看到更多安全驱动的设计涌现,使AI不仅赋能生活,更成为值得信赖的伙伴。

如若转载,请注明出处:http://www.wmvpau.com/product/55.html

更新时间:2026-05-29 09:28:55